안정 확산이란 무엇이며 그 힘을 극대화하는 방법

인공 지능의 발전은 이제 사진 생성에 도움이 되는 일부 프로그램을 대체하고 있습니다. Stable Diffusion 도구가 표시될 수 있습니다. 하지만 안정확산이란 무엇인가? 이미지 생성 도구입니다. 주요 목적은 프롬프트를 사용하여 그림을 생성하는 것이며, 사람들은 다양한 캐릭터와 요소를 함께 생성하는 것이 매력적이고 재미있다고 생각합니다. Stable Diffusion이 무엇인지 자세히 알아보고 작동 방식을 알아보세요.

가이드 목록

1부: 안정 확산이란 무엇입니까? 2부: VAE 안정 확산이란 무엇입니까? 3부: Stable Diffusion의 Dreambooth란 무엇이며 설치 방법 4부: 안정 확산에서 CFG 규모란 무엇입니까? 5부: 잡음 제거 강도 안정 확산이란 무엇입니까? 6부: Clip Skip Stable Diffusion이란 무엇이며 사용 방법 7부: 안정 확산 생성 속도란 무엇이며 가속 방법은 무엇입니까? 파트 8: 안정 확산에 관한 FAQ1부: 안정 확산이란 무엇입니까?

주요 주제를 설명하는 프롬프트를 입력하여 그림을 만드는 딥러닝, 텍스트-이미지 모델입니다. 예를 들어 '고양이'를 입력하면 도구에서 고양이 사진을 생성합니다. 그러나 복잡한 프롬프트를 입력하면 더 많은 세부 정보를 강조하거나 추가할 수 있습니다. 생성 신경망은 아웃페인팅(outpainting), 인페인팅(inpainting), 텍스트 프롬프트를 통한 이미지 대 이미지 번역과 같은 다른 작업으로도 조절되므로 AI 도구 이상의 역할을 합니다.

Stable Diffusion은 Stability AI에서 개발하고 자금을 지원했지만 뮌헨 Ludwig Maximilian University의 CompVis 그룹은 잠재 확산 모델에 대한 기술 라이선스를 보유하고 있습니다. 또한 이 개발은 연구원 Patrick Esser와 Robin Rombach가 주도하여 프로젝트 후원자인 독일의 비영리 조직으로부터 더 많은 교육 데이터를 얻었습니다. 회사는 2022년 8월 처음 도입한 후 2022년 10월 후반에 US$1억 1백만 달러를 모금했습니다.

2부. VAE 안정 확산이란 무엇입니까?

AI 사진 생성기를 사용할 때 이런 문제가 발생했을 수 있으며 VAE는 이 도구에 도움이 됩니다. VAE는 Variable Auto Encoder(가변 자동 인코더)를 의미하며 디코더를 미세 조정하여 더 나은 세부 사항을 그리는 데 사용됩니다. 보다 선명한 이미지와 생생한 색상을 얻고 손과 얼굴의 생성을 개선하는 데 도움이 될 수 있으므로 AI 도구에 추가됩니다.

물론 VAE는 모든 모델에 세부 사항을 해결하기 위한 VAE가 내장되어 있기 때문에 Stable Diffusion 이상의 기능을 제공합니다. 비교는 각 모델 간의 결과와 사진을 압축했을 때 어떻게 나타나는지 보여줍니다. 또한 장치에 다운로드할 수 있는 별도의 VAE 파일이 있습니다. 하나의 디코더를 사용해 보려면 다음을 사용할 수 있습니다.

- 애니메이션용 Orangemix/모든 VAE.

- 애니메이션용 Kl-f8-anime2.

- 사실주의 또는 회화를 위해 Vae-ft-mse-840000-ema-pruned.

Part 3. Dreambooth란 무엇이며 Stable Diffusion은 어떻게 설치하나요?

DreamBooth는 생성된 그림, 특히 특정 주제를 미세 조정하는 딥 러닝 생성 모델입니다. 처음에는 Imagen의 텍스트-이미지 모델을 기반으로 하지만 안타깝게도 Imagen에는 Stable Diffusion이나 기타 AI 도구와 같이 사전 훈련된 가중치가 없습니다. DreamBooth는 2022년에 Google 연구원과 보스턴 대학교의 일부 동료에 의해 추가로 개발되었습니다.

모델의 작업은 생성된 사진을 수정하고 미세 조정하는 것이지만 어떤 설정과 상황에서도 친숙한 피사체를 렌더링할 수도 있습니다. 대부분의 사전 훈련된 확산 모델은 이 범주에서 여전히 개선되어야 하기 때문에 DreamBooth는 확산 모델에 대한 훈련을 강화할 것입니다. 단 5개의 이미지만으로 Stable Diffusion과 같은 플랫폼을 사용하여 이미지 수정을 수행할 수 있습니다. Stable Diffusion에서 DreamBooth를 사용하는 방법에 대한 간단한 지침은 다음과 같습니다.

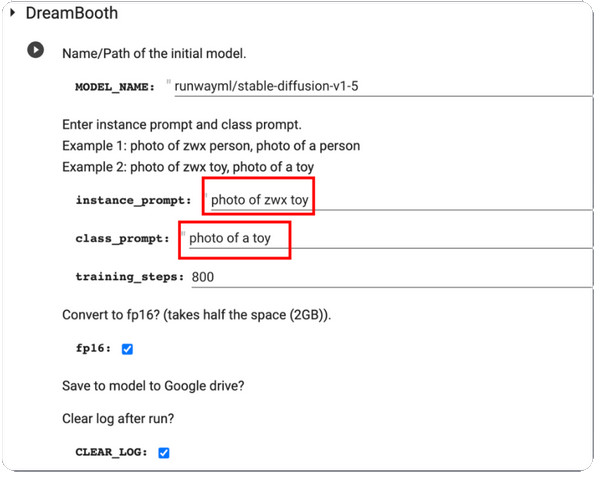

1 단계.먼저 DreamBooth에서 사용할 한 주제의 학습 이미지가 있어야 합니다. 피사체에 사진이 캡처되어 있는지 확인하십시오. 계속해서 사진 크기를 512x512 픽셀로 조정합니다.

2 단계.DreamBooth를 열고 입장하세요. 인스턴스 프롬프트 그리고 수업 프롬프트. 다음을 클릭하여 변경 사항을 처리합니다. 놀다 버튼을 클릭하세요.

3단계.완료되면 테스트하면 모델에서 생성된 몇 가지 샘플을 받게 됩니다. Google Drive에서 모델 체크포인트 파일을 다운로드하여 GUI에 설치할 수 있습니다.

4부. 안정 확산에서 CFG 스케일이란?

사진 생성기 모델 내에서 이 값 세트를 찾을 수 있습니다. 그리고 필수적이기 때문에 이미지를 최적화할 가치가 있는 것이 무엇인지 배워야 합니다. 분류자 자유 안내 척도(Classifier Free Guidance Scale)를 통해 사용자는 입력 이미지 또는 사용된 프롬프트의 결과 근접성을 조정할 수 있습니다. 예를 들어 CFG Scale을 더 우수한 값으로 조정하면 출력은 입력 이미지와 더 유사하지만 왜곡이 예상됩니다. 반면, CGF 규모가 낮을수록 더 나은 품질을 생성하면서 출력이 기본 프롬프트에서 멀리 떨어져 있게 됩니다.

그런데 언제 Stable Diffusion에서 CFG 스케일을 사용해야 합니까? 대답은 간단합니다. AI 사진 생성기는 자신이 알지 못하는 것을 만들 수 없으므로 CFG 스케일은 그 가치를 높여 여러 피사체를 결합하는 데 도움이 됩니다. 유일한 단점은 프롬프트에 비례하여 이미지 품질이 저하된다는 것입니다. 이 도구에 관심이 있다면 최적의 지점을 찾기 위해 저울 교정을 연습해야 합니다.

5부. 잡음 제거 강도 안정 확산이란 무엇입니까?

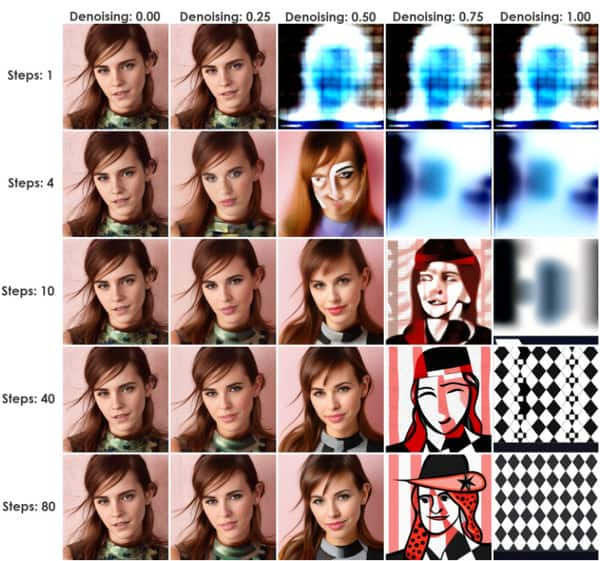

이 방법은 입력 이미지에 노이즈를 추가하는 프로세스를 시작합니다. 그것은 단지 안정적인 확산 업스케일러. image-to-image(img2img) 또는 InPaint를 통해 얻을 수 있으므로 Stable Diffusion에 탁월한 값입니다. 노이즈 양은 Denoise Strength에 의해 최소 0에서 최대 1까지 제어됩니다. 값을 0으로 설정하면 노이즈가 전혀 없어져 입력 이미지와 유사한 이미지가 만들어집니다. 그렇지 않으면 값 1이 입력을 노이즈로 대체합니다.

입력 이미지의 영향과 출력의 근접성을 확인하기 위한 실용적인 방법으로 노이즈 제거 강도를 사용할 수 있습니다. 좋은 예는 생성된 이미지를 입력에 더 가깝게 보이도록 만드는 낮은 노이즈 제거 강도입니다. 이는 사소한 수정에 이상적인 설정입니다. 반면, 노이즈 제거 강도가 높을수록 입력 이미지와 출력 이미지의 유사성은 감소하면서 변형이 증가할 가능성이 높습니다. 따라서 중요한 수정에는 값이 높을수록 도움이 됩니다.

6부. Clip Skip Stable Diffusion이란 무엇이며 어떻게 사용하나요?

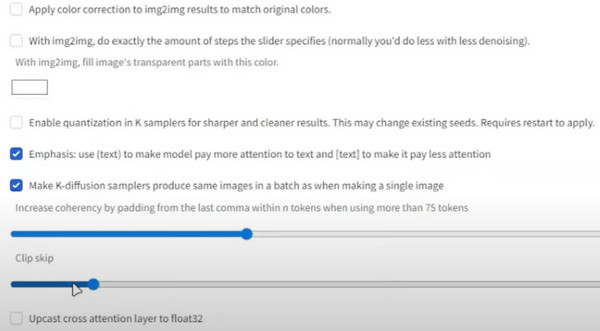

CLIP은 텍스트 분석에 사용되는 임베딩 레이어로 알려져 있습니다. 그 구조는 계층으로 구성되어 있으며, 개인별로 이전보다 더 구체적입니다. 예를 들어 레이어 1은 "사람"이 될 수 있고 레이어 2는 "여성" 또는 "남성"이 될 수 있습니다. 그러면 다음 레이어는 '부모, 아버지, 남자, 소년 등'이 됩니다.

그 목적은 긴 레이어 목록을 중지하고 결국 더 많은 데이터를 혼합하여 필요한 것보다 더 많은 것을 제공하는 정확한 텍스트 모델을 얻는 것입니다. 이에 대한 가장 좋은 예는 12등급 깊이의 1.5 모델입니다. 각 레이어에는 텍스트가 포함되어 있으며 크기, 색상 등과 같은 다른 세부 정보와 혼합될 수 있습니다. CLIP은 텍스트 공간 차원을 건너뛰고 정확한 출력을 얻습니다. 사용 방법은 다음과 같습니다.

1 단계.Stable Diffusion Checkpoint에서 설정으로 이동하여 “Stable Diffusion”을 선택하세요.

2 단계.아래로 스크롤하여 "클립 건너뛰기"로 이동합니다. 원하는 값으로 설정한 후 위로 스크롤하여 "설정 적용" 버튼을 클릭하세요.

Part 7. 안정확산 생성속도란 무엇이며 어떻게 가속하는가?

AI 생성기의 속도를 살펴보면 결과가 표시되는 데 시간이 좀 걸릴 것이라고 예상할 수 있습니다. 그러나 안정 확산의 생성 속도는 10초입니다. 이는 온라인 도구의 일반적인 사용에만 해당되지만 기본 또는 표준 요금제에 가입하면 시간이 최대 4초까지 단축될 수 있습니다. 이는 모델의 속도를 가속화하는 한 가지 방법이지만 결과의 정확도는 입력에서 멀어집니다. 안정적인 확산 프롬프트. 또한 이 도구는 유료 요금제에서 몇 가지 기능 제한만 제외하고 무료입니다. 그렇다면 비용을 지불하지 않으면서 어떻게 생성 속도를 가속화할 수 있을까요?

가속을 위한 유일한 요구 사항은 4000, 3000, 2000 및 1000 시리즈에 있을 수 있는 Nvidia 카드입니다. Lovelace, Ampere, Pascal Turing 등을 사용할 수 있습니다. 대안으로 float16과 같은 낮은 정밀도를 사용하고 더 적은 추론 단계를 실행하십시오.

보너스 팁: 안정 확산 결과 크기 변경

AI 모델에 대해 학습한 후 알아야 할 한 가지가 더 있습니다. 파일 크기는 이미지의 중요한 요소이며 파일 크기가 크기 때문에 저장 공간을 차지할 수 있습니다. 하지만 함께 AnyRec 무료 이미지 압축기 온라인, 사진을 압축하는 것이 편리합니다. 온라인 도구에는 파일 크기를 줄이면서 업로드를 최적화하는 데 도움이 되는 최신 AI 기술이 있습니다. 더 작은 파일을 생성하므로 사용자는 로컬 폴더에서 더 많은 이미지를 가져올 수 있으며 압축기는 해당 이미지를 즉시 로드합니다.

- Stable Diffusion에서 생성된 이미지를 품질로 압축합니다.

- 압축된 이미지에는 워터마크가 적용되지 않습니다.

- JPEG, GIF, TIFF, BMP, PNG 등과 같은 형식을 지원합니다.

- 왜곡되고 흐릿하며 채워지는 새 픽셀을 이미지에 자동으로 수정합니다.

8부. 안정 확산에 관한 FAQ

-

1. Stable Diffusion을 오프라인으로 사용할 수 있나요?

예. 이 도구는 인터넷 연결 없이도 사용할 수 있습니다. 합성 데이터를 로컬에 저장할 수 있어 AI 모델이 인터넷 네트워크 없이도 사용할 수 있도록 훈련할 수 있기 때문입니다.

-

2. AI 사진생성기의 단점은 무엇인가요?

장점 외에도 이 도구는 계산 집약적일 수 있지만 더 광범위한 데이터가 포함된 사진 및 비디오를 처리할 때 시간이 소모됩니다. 또 다른 하나는 품질이 사용된 입력 데이터와 네트워크 매개변수에 따라 달라진다는 것입니다. 이는 고품질 이미지를 얻을 것이라는 보장이 없음을 의미합니다.

-

3. Stable Diffusion을 사용할 때 고급 장비가 필요한가요?

아니요. 사진 생성기는 최신 컴퓨터 버전 없이도 사용할 수 있습니다. 최신 버전이 있어도 AI 생성기를 사용하면 충분합니다.

-

4. 문자 메시지는 어디서 받을 수 있나요?

Stable Diffusion에는 프롬프트 검색에 도움이 되는 텍스트 프롬프트 엔지니어가 내장되어 있습니다. 텍스트를 입력하고 검색 버튼을 클릭하면 됩니다. 결과는 샘플 이미지와 함께 몇 초 안에 표시됩니다.

-

5. 온라인 도구를 실행하려면 어떤 GPU가 필요합니까?

대부분의 GPU를 지원하므로 6GB에서 Nvidia 및 AMD로 AI 이미지 생성기를 실행할 수 있습니다.

결론

이 게시물은 설명합니다 안정확산이란 무엇인가 Clip Skip, VAE, DreamBooth, CFG Scale 및 Denoising Strength와 함께 작동하는 방식을 알아보세요. 반면에 AnyRec Free Image Compressor Online을 사용하면 생성된 사진의 파일 크기를 줄일 수 있습니다. 완전히 무료이며 무제한으로 사용할 수 있습니다!