Jak krok po kroku przywrócić twarze przy stabilnym rozproszeniu

W ostatnich latach sztuczna inteligencja poczyniła postępy w każdej dziedzinie, aby zwiększyć realistyczne wyniki, szczególnie w przypadku generatorów zdjęć. Ale czasami nadal musisz przywróć twarze w Stable Diffusion. Bo chociaż może automatycznie tworzyć obrazy z podpowiedzi w ciągu kilku sekund, wadą są tutaj zniekształcone lub rozmyte części twarzy. Można to poprawić różnymi metodami. W tym artykule omówiono każdą opcję, więc znajdź najlepszą, która przywróci twarze w Stable Diffusion.

Lista przewodników

Część 1: Dlaczego twarze są rozmyte przy stabilnym rozproszeniu Część 2: Jak przywrócić twarz w stabilnym rozproszeniu za pomocą AUTOMATIC1111 Część 3: Użyj Google Colab, aby przywrócić twarze w stabilnym rozproszeniu Część 4: Często zadawane pytania dotyczące przywracania ścian w stabilnym rozproszeniuCzęść 1: Dlaczego twarze są rozmyte przy stabilnym rozproszeniu

Zanim przejdziesz do przywracania twarzy w Stable Diffusion, odpowiedzmy na to powiązane pytanie. Sieć neuronowa z ogromnym zbiorem danych obrazów trenuje generator zdjęć AI. Technika ta stanowi podstawowy system narzędzia, pozwalający bez wysiłku uzyskać wysokiej jakości wydruki. Niestety, nadal nie jest doskonały i czasami może odbiegać od wyników wyświetlanych w monitach wejściowych. Powoduje to zniekształcenie widoczne na wygenerowanych obrazach, brak subtelnych rzeczy i różnic w ludzkiej twarzy, dłoniach i innych częściach.

Dodatkowo niektóre ustawienia wymagają dokładnego dostosowania, a jednym z nich jest skala CFG. Jest to ogromny czynnik wpływający na wynik, ponieważ może dopasować szczegóły do podpowiedzi. Kolejnym jest zastosowany monit. Nawet jeśli jako podpowiedzi uwzględnisz wszystkie znane słowa, funkcja Stable Diffusion prawdopodobnie da zniekształcone wyniki, jeśli nie będą one znane wcześniej. Mimo to przyjrzyjmy się metodom naprawienia zniekształceń na zdjęciach AI.

Część 2: Jak przywrócić twarz w stabilnym rozproszeniu za pomocą AUTOMATIC1111

Możesz wziąć pod uwagę wszystkie możliwe przyczyny zniekształceń ludzkich twarzy na generowanych zdjęciach. Ale na szczęście nadal możesz to naprawić w trybie Stable Diffusion, korzystając z dwóch poniższych metod.

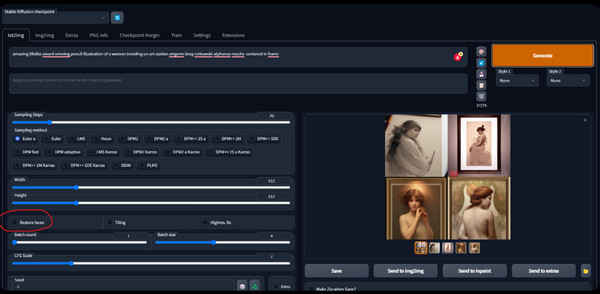

1. Przywróć twarze za pomocą interfejsu internetowego o stabilnej dyfuzji AUTOMATIC1111

A1111 to dodatkowe rozwiązanie dla zaawansowanych użytkowników. Oferuje najwięcej nowych funkcji, ale pamiętaj, że nie jest to najbardziej dostępna platforma, ponieważ wymaga większej ilości dokumentacji. Ma także bardzo zastraszającą listę funkcji, które komplikują konfigurację. Mimo to rozważ zalety A1111 w wypełnianiu zniekształconych części, korekcji kolorów i ulepszaniu obrazu. Zobacz poniższą demonstrację, jak używać interfejsu WWW AUTOMATIC1111 stable-Dffusion do przywracania twarzy w trybie Stable Diffusion:

Krok 1.Po wygenerowaniu obrazu w narzędziu przejdź do menu i znajdź opcję „Przywróć twarze”. Kliknij na niego, aby zastosować rozwiązanie.

Krok 2.Jeśli chcesz naprawić oczy lub inne części, prześlij nowe zdjęcie do menu Extra Tab. Upewnij się, że masz wpływ Code Forer lub GFPGAN i więcej konfiguracji, jeśli to konieczne.

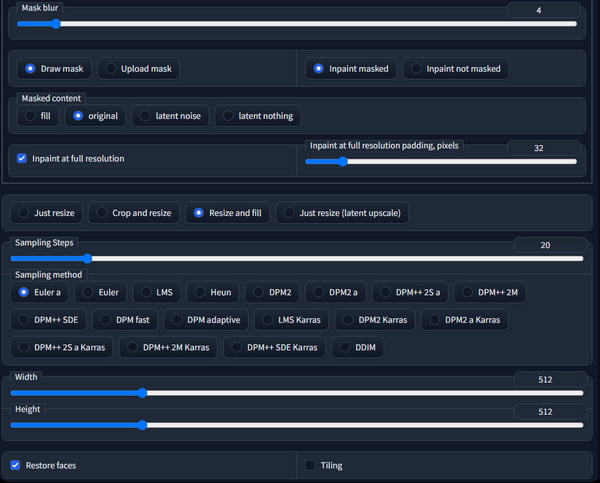

2. Malowanie za pomocą webui o stabilnej dyfuzji AUTOMATIC1111

Inpainting to kolejna funkcja, którą można znaleźć w AUTOMATIC1111 stable-diffusion-webui. Jedną z jego funkcji jest uzupełnienie brakujących szczegółów wygenerowanego obrazu, jako potężnego Skaler obrazu zapewniający stabilną dyfuzję. Najlepsze jest to, że użytkownik może ręcznie wybrać części obrazu do edycji, a narzędzie automatycznie generuje nowe szczegóły. Postępuj zgodnie z poniższą demonstracją, aby użyć Inpainting:

Krok 1.Przejdź do menu img2img i wybierz opcję Inpaint. Wybierz część, którą chcesz naprawić; może to być ludzka twarz lub części, takie jak oczy, uszy itp.

Krok 2.Skonfiguruj ustawienia zgodnie ze swoimi potrzebami. Jeśli nie znasz opcji, spróbuj zastosować ustawienia z poniższego obrazka.

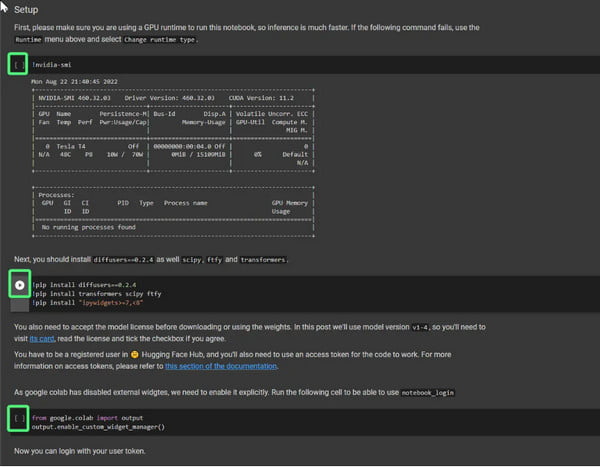

Część 3: Użyj Google Colab, aby przywrócić twarze w stabilnym rozproszeniu

Ponieważ Stable Diffusion jest dostępne publicznie, nawet w przypadku wersji płatnej, konfiguracji można dokonać za pomocą Hugging Face Spaces za pośrednictwem Google Colab. Ten aplikacja do edycji twarzy jest również bezpłatny i wystarczy kilka kliknięć, aby przywrócić twarze na zdjęciach. Google Colab to platforma oparta na chmurze, więc otaczające ją kody mogą Cię przerazić. W przeciwieństwie do tego, nie musisz uczyć się kodowania, aby uruchomić ten program; zamiast tego wykonaj poniższe proste kroki.

Krok 1.Pobierz Stable Diffusion od Hugging Face i utwórz konto. Następnie skopiuj notatnik Stable Diffusion Colab zapisany na dysku. Na tym etapie upewnij się, że używasz Google Colab na GPU. Można to zmienić w menu Środowisko wykonawcze w obszarze Zmień typ środowiska wykonawczego.

Krok 2.Uruchom pierwsze komórki, najeżdżając myszką na każdą komórkę na platformie. Kliknij przycisk „Odtwórz” i poczekaj na zielony znacznik wyboru po zakończeniu. Musisz także uruchomić piątą komórkę, aby pobrać wszystkie niezbędne pliki. Wygeneruj pierwszy obraz z procesem przywracania, wprowadzając odpowiednie monity.

Dodatkowe wskazówki: Zmniejsz stabilną dyfuzję i przywróć obrazy twarzy

Załóżmy, że potrafisz przywracać twarze w trybie Stable Diffusion, ale chcesz zmniejszyć rozmiar pliku obrazów. W takim przypadku możesz użyć Darmowy kompresor obrazu AnyRec online dla najprostszej metody. Może zmniejszyć rozmiar pliku nawet o 80%, zachowując oryginalną jakość obrazu. To narzędzie zapewnia 40 bezpłatnych miejsc na przesyłanie, z maksymalnie 5 MB na każde zdjęcie do skompresowania do KB.

- Kompresuj obrazy, aby zachować oryginalną jakość obrazu i dane.

- Zmniejsz partię obrazów wygenerowanych metodą Stable Diffusion jednym kliknięciem.

- Obsługuje typy obrazów, w tym JPEG, PNG, SVG i GIF.

- Nie ma potrzeby tworzenia konta i nie jest stosowany żaden znak wodny.

Część 4: Często zadawane pytania dotyczące przywracania ścian w stabilnym rozproszeniu

-

1. Jakie ustawienia powinienem skonfigurować na A1111?

Dzięki obszernej liście ustawień możesz skonfigurować te opcje przywracania twarzy. Sprawdź CodeFormer, Szybkie ustawienia na stronie Ustawienia i wybierz VAE wydane przez Stability po jego pobraniu.

-

2. Czy mogę przywrócić twarze w Stable Diffusion przy użyciu skali CFG?

Nie. Chociaż ta opcja spowoduje zbliżenie do podpowiedzi i wygenerowanych obrazów, nadal nie ma gwarancji, że naprawi ludzkie twarze. Co więcej, najlepszą opcją dla skali CFG jest wartość od 7 do 10, co ogranicza możliwość dalszej konfiguracji.

-

3. Jaka jest wada generowania obrazu całego ciała za pomocą narzędzia AI?

Zniekształcone części są główną wadą generacji całego ciała w stabilnej dyfuzji. Może to być cała twarz, nogi, dodatkowe kończyny itp. Może się pogorszyć, jeśli utworzysz obraz w małej rozdzielczości około 1024 pikseli lub niższej.

-

4. Jaka jest alternatywna metoda uzyskania dobrej twarzy w Stable Diffusion?

Podpowiedzi odgrywają ogromną rolę w generatorze AI. Sugeruje się załączenie słów kluczowych konkretnego artysty oraz konkretnego opisu, np. szczegółów twarzy i podpowiedzi negatywnych.

-

5. Czy posiadanie duplikatów w Stable Diffusion jest błędem?

Tak. Jeśli po wygenerowaniu zdjęcia widzisz dwie twarze, musisz to naprawić za pomocą rozwiązań opisanych w tym artykule. Jednak błąd zwykle występuje w przypadku korzystania z rozmiaru obrazu w orientacji pionowej, więc można go naprawić, zmieniając rozmiar obrazu.

Wniosek

Chociaż otrzymanie zniekształconego zdjęcia ze Stable Diffusion jest rozczarowujące, nadal możesz przywróć twarze w Stable Diffusion przy użyciu A1111, Inpainting i Google Colab. W celu skutecznej kompresji obrazu zaleca się użycie AnyRec Free Image Compressor Online. Odwiedź oficjalną stronę internetową i zobacz najlepsze rozwiązanie!